高速数据处理 定义、最新进展与商务咨询价值

在当今这个信息爆炸的时代,数据已成为驱动商业决策、科学研究和日常生活的核心燃料。而如何高效、精准地处理海量、快速变化的数据流,便催生了对“高速数据处理”技术的迫切需求。本文将深入探讨高速数据处理的内涵,梳理其最新技术动态,并阐明其在商务信息咨询领域的关键价值。

一、什么是高速数据处理?

高速数据处理,是指在数据生成后极短的时间窗口内(通常是毫秒、微秒甚至纳秒级),完成对数据的捕获、传输、清洗、分析、存储和响应的全过程。它超越了传统批量处理的模式,强调“实时”或“近实时”的能力。其核心挑战在于应对数据的“3V”特性在高速场景下的极致化:

- 海量(Volume):数据源持续不断地产生巨量数据。

- 高速(Velocity):数据生成和传输的速度极快,如金融市场的交易数据、物联网传感器数据、在线用户行为日志等。

- 多样(Variety):数据格式复杂,可能包括结构化、半结构化和非结构化数据。

实现高速数据处理依赖于一系列关键技术栈,包括分布式计算框架(如Apache Flink、Apache Storm、Spark Streaming)、高性能消息队列(如Apache Kafka、Pulsar)、流数据库、内存计算以及优化的网络和存储基础设施。

二、高速数据处理的最新报道与技术前沿

该领域正以前所未有的速度演进,近期的主要趋势和报道焦点包括:

- 流批一体架构成为主流:以Apache Flink为代表的框架,正推动流处理(实时)和批处理(历史)在编程模型和底层执行引擎上的统一。企业无需维护两套系统,即可同时满足实时分析与历史数据挖掘的需求,极大简化了架构复杂度和运维成本。

- 实时人工智能与机器学习:将机器学习模型集成到数据流中,实现实时预测、异常检测和智能决策。例如,实时反欺诈系统可以在交易发生的瞬间分析数百个特征并做出拦截判断;工业物联网平台能实时预测设备故障。

- 云原生与Serverless化:主流云服务商(AWS Kinesis, Google Cloud Dataflow, Azure Stream Analytics)提供了全托管的高速数据处理服务。企业可以更专注于业务逻辑,而无需管理底层集群,实现了弹性伸缩和按需付费。

- 边缘计算的深度融合:为应对网络延迟和数据隐私挑战,高速数据处理能力正下沉至网络边缘。在靠近数据源头的边缘设备或网关进行初步过滤、聚合和分析,只将关键结果或汇总信息传回云端,大幅提升了响应速度和系统可靠性。

- 实时数据湖与数据仓库的演进:诸如Apache Iceberg、Hudi和Delta Lake等表格格式,使得在数据湖上也能进行高效的流式更新和实时查询,模糊了数据湖与实时数据仓库的界限,支撑更灵活的实时分析场景。

三、高速数据处理在商务信息咨询中的核心价值

对于商务信息咨询行业而言,高速数据处理已从“加分项”演变为“必需品”,它重塑了咨询服务的洞察力、速度和精准度:

- 驱动实时商业决策:咨询公司可以帮助客户构建实时仪表盘和预警系统,监控关键业务指标(如销售额、网站流量、供应链状态、社交媒体舆情)。决策者能够基于最新的市场动态而非上周的报告做出调整,把握转瞬即逝的商机或规避风险。

- 深化客户洞察与个性化体验:通过实时分析用户行为流数据,咨询顾问可以协助企业绘制动态的客户旅程图,即时识别客户意图、偏好与痛点。这为实施个性化的营销推荐、动态定价和客户服务干预提供了可能,极大提升客户满意度和转化率。

- 优化运营与风险管理:在金融、零售、物流等行业,高速数据处理能力是风险控制和运营效率的生命线。咨询项目可以围绕构建实时反欺诈、信用风险监控、物流路线动态优化、生产线质量实时检测等系统展开,直接为企业降本增效、保障安全。

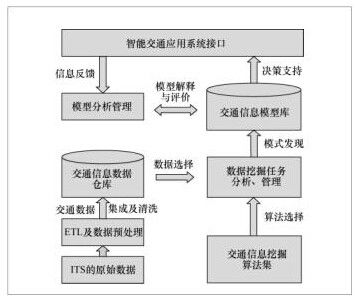

- 孵化数据驱动的创新产品与服务:咨询公司可以借助高速数据处理技术,协助客户探索新的商业模式。例如,基于实时位置和交通数据的智能出行服务,基于实时能源消耗数据的节能解决方案,或基于实时供应链数据的柔性制造平台。

- 提升咨询分析本身的速度与深度:咨询团队在项目调研阶段,可以利用高速数据处理工具快速采集、清洗和分析多源异构的公开及私有数据,缩短分析周期,让结论和建议建立在更及时、更全面的数据基础之上。

高速数据处理技术正不断打破数据价值释放的速度壁垒。它不仅是一套复杂的技术集合,更是企业构建核心竞争优势的战略能力。对于商务信息咨询行业,深刻理解并善用这项能力,意味着能为客户提供更具前瞻性、响应力和可操作性的解决方案,在数据驱动的商业新时代,共同驾驭信息的洪流,将实时洞察转化为切实的商业成功。

如若转载,请注明出处:http://www.chelianefu.com/product/63.html

更新时间:2026-05-28 08:34:55